LLMOとは? — Large Language Model Optimizationの意味と定義

LLMO(エルエルエムオー)は「Large Language Model Optimization」の略称で、日本語では「大規模言語モデル最適化」と訳されます。一言で定義すると、LLMOとは、ChatGPT・Gemini・Perplexityなどの大規模言語モデル(LLM)ベースのAI検索サービスにおいて、自社のコンテンツが情報源として選ばれ、ユーザーへの回答に引用・推奨されるよう最適化する施策のことです。

この定義を聞いて「それってSEOと何が違うの?」と感じた方も多いでしょう。確かに、「自社コンテンツをユーザーに届ける」という最終目標は共通しています。しかし、その「届け方」が根本的に異なります。

従来のSEOでは、Googleの検索結果ページに自社サイトのリンクを表示させ、ユーザーにクリックしてもらうことがゴールでした。一方、LLMOでは、AIが生成する回答テキストの中に自社の情報が直接埋め込まれることがゴールです。ユーザーはサイトを訪問しなくても自社の情報に触れることになり、出典リンクが付与されていればそこからの流入も期待できます。

では、具体的にどのAIサービスが対象になるのでしょうか。2026年3月時点で主要なサービスを整理しました。

| AIサービス | 提供元 | 特徴 | 情報ソース |

|---|---|---|---|

| ChatGPT | OpenAI | 会話型AI+Web検索統合。回答に出典リンクを表示 | Bing検索ベース |

| Gemini | Google検索と深く統合されたAIアシスタント | Googleインデックス | |

| Perplexity | Perplexity AI | AI検索に特化。回答に必ず出典URLを明示 | 独自クロール+検索API |

| Claude | Anthropic | 高精度な長文回答生成に強み | Web検索連携 |

| Microsoft Copilot | Microsoft | Bing検索と連携したAI検索 | Bingインデックス |

この表から読み取れる重要なポイントがあります。それは、各AIサービスが参照する「情報ソース」がそれぞれ異なるということです。ChatGPTはBing、GeminiはGoogle、Perplexityは独自クロールというように、情報の取得元が違います。これは後述する「AI検索エンジン別の個別対策」に直結する重要な事実です。

また、類似する用語として「AIO(AI Overview Optimization)」や「GEO(Generative Engine Optimization)」がありますが、対象範囲が異なります。AIOはGoogleのAI Overviewに特化した狭い概念で、GEOは学術研究から生まれた広い概念です。LLMOはその中間で、実務家コミュニティから生まれた用語として日本国内で最も広く使われています。これらの違いは後のセクションで詳しく整理します。

LLMが回答を生成する仕組み — LLMO対策の前提知識

「なぜこの対策が有効なのか」を理解するには、LLMがどのように情報を取得し、回答を組み立てているかを知る必要があります。仕組みを知らずに対策だけ実行しても、本質的な改善にはつながりません。ここでは、LLMO対策に直結する2つの技術的な仕組みを、専門知識がなくても理解できるように解説します。

LLMの2つの情報ソース — 事前学習とリアルタイム検索

LLM(大規模言語モデル)が回答を生成する際に使う情報ソースは、大きく2種類に分かれます。

1つ目は「事前学習データ」です。これは、インターネット上の膨大なテキスト——Webページ、書籍、論文、Wikipediaなど——を事前に読み込んで学習した知識のことです。人間に例えれば「これまでの人生で読んできた本や記事の記憶」にあたります。ただし、この記憶には鮮度の問題があります。学習データには数ヶ月〜1年以上前の情報しか含まれないため、最新の出来事や変更には対応できません。

2つ目は「リアルタイム検索データ」です。ChatGPTのBrowsing機能やPerplexityの検索がこれにあたり、ユーザーの質問を受けてからWeb検索を実行し、最新の情報を取得します。人間に例えれば「質問されてからその場でスマホで調べる」行為に近いものです。

LLMO対策で圧倒的に重要なのは、この2つ目のリアルタイム検索データです。なぜなら、事前学習データを書き換えることは事実上不可能ですが、リアルタイム検索で拾われるコンテンツは「今この瞬間にWeb上に公開されているもの」だからです。つまり、自社サイトのコンテンツを改善すれば、AIの回答に反映される可能性があるということです。この点で、LLMOは従来のSEOと同じく「現在のWebサイトの状態」を最適化する施策だと言えます。

RAG(検索拡張生成)— AIが「引用元」を選ぶプロセス

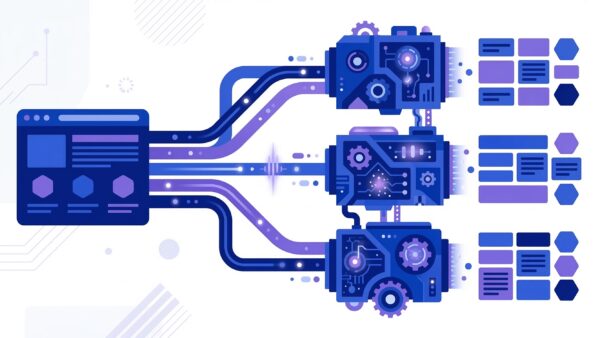

最新のAI検索サービスの多くが採用している中核技術が、RAG(Retrieval-Augmented Generation:検索拡張生成)です。名前は難しそうですが、仕組みは「調べてから答える」というシンプルなものです。具体的には以下の5ステップで処理が行われます。

- クエリ解析:ユーザーの質問を分析し、「何を知りたいのか」を理解する。曖昧な質問は複数の検索クエリに分解されることもある

- 情報検索(Retrieval):Web検索やインデックスから、質問に関連性の高いドキュメントを10〜20件程度取得する

- チャンク分割:取得したドキュメントを段落・セクション単位の「チャンク」に分割する。1ページ丸ごとではなく、意味のまとまりごとに切り分けるのがポイント

- 関連性スコアリング:各チャンクと質問の関連度をスコアリングし、上位のチャンクを選定する。ここで「どの段落を引用するか」が決まる

- 回答生成(Generation):選定されたチャンクの情報を参照しながら、自然で読みやすい文章として回答を生成する

このプロセスから、LLMO対策における最も重要なインサイトが得られます。それは、AIは「ページ全体」ではなく「チャンク(段落・セクション)単位」で情報源を選んでいるということです。

従来のSEOでは、ページ全体の品質スコア(被リンク数、ドメインパワー、ページの総合的な内容)で順位が決まっていました。しかしLLMOでは、たとえページ全体の品質が高くても、個々の段落が曖昧で回答に使いにくければ引用されません。逆に、ドメインパワーが小さいサイトでも、特定の質問に対して「完璧に明確な回答」を含む段落があれば、そこだけが引用される可能性があるのです。

この「チャンク単位の評価」という性質が、後述する対策手法——結論ファーストの段落構成、明確な定義文の配置、FAQPageスキーマの実装——の根拠になっています。

なぜ今LLMOが必要なのか — 2026年のAI検索市場データ

「LLMOが大事なのはわかったけど、今すぐ取り組む必要があるの?」という疑問は当然です。答えは「はい、今すぐ」です。その理由を、具体的な市場データで示します。

| 指標 | 数値・傾向 | 出典・時期 |

|---|---|---|

| ChatGPT月間アクティブユーザー | 約4億人 | OpenAI発表(2026年初頭) |

| Google AI Overview表示率 | 検索クエリの約40〜50% | 業界調査(2026年Q1) |

| Perplexity月間検索クエリ数 | 約5億回 | Perplexity公式(2025年末) |

| AI検索経由Webトラフィック成長率 | 前年比200%超 | SimilarWeb(2025年) |

| Gartner予測:従来検索の減少幅 | 2026年末までに約25%減 | Gartner社予測(2024年発表) |

| オーガニック検索1位CTR低下幅 | AIO表示時に30〜60%低下 | 各種SEOツール調査 |

数字だけを見ても危機感は湧きにくいかもしれません。しかし、この表が示しているのは「ユーザーの情報探索行動が、検索結果ページからAIの回答画面へと移動している」という構造的な変化です。

特に深刻なのが「ゼロクリック検索」の加速です。これは、ユーザーがAIの回答だけで情報収集を完結させ、元のWebサイトを一切訪問しないケースを指します。従来のSEOで検索1位を獲得していたとしても、AI Overviewがその上に表示されれば、クリック率は30〜60%も低下するというデータがあります。

しかし、悲観する必要はありません。ここで重要なのは、AI Overviewに引用されているサイトは、むしろクリック率が上がっているケースも少なくないということです。つまり、ゼロクリック化はLLMO対策を「していない」サイトにとっての脅威であり、対策を「している」サイトにとっては新たなチャンスなのです。

scale-basics.comの運用でも、この傾向は明確に表れています。AI Overviewに引用されているページは、引用されていないページと比較して、CTRの低下幅が約40%小さいという結果が出ました。さらに、Perplexityからのリファラルトラフィックは3ヶ月で約3倍に成長しており、AI検索が「従来の検索トラフィックを奪う脅威」ではなく「新しい流入チャネル」として機能し始めています。

AI検索の基本的な仕組みをより深く理解したい方は、第21章 AI検索の仕組みとAIO基礎で体系的に学ぶことができます。

LLMOとSEO・AIO・GEOの違い — 用語の混乱を整理する

AI検索最適化の話題では、LLMO以外にも「AIO」「GEO」「AEO」といった類似の用語が飛び交い、混乱しがちです。「結局どれを使えばいいの?」という疑問に、シンプルに答えます。

| 用語 | 正式名称 | 対象範囲 | 主な焦点 | 由来 |

|---|---|---|---|---|

| SEO | Search Engine Optimization | Google・Bingなどの従来型検索 | 検索結果ページでの上位表示 | 実務(1990年代〜) |

| AIO | AI Overview Optimization | GoogleのAI Overviewのみ | Google AI回答への引用 | 実務(2024年〜) |

| LLMO | Large Language Model Optimization | LLMベースのAIサービス全般 | LLM回答への引用・推奨 | 実務コミュニティ |

| GEO | Generative Engine Optimization | 生成AI搭載の検索エンジン全般 | 生成AI回答への引用 | 学術研究(2023年〜) |

この表を見ると、4つの用語は「対象範囲の広さ」で分類できることがわかります。最も狭いのがAIO(GoogleのAI Overviewだけ)、最も広いのがLLMOとGEO(AI検索全般)です。LLMOとGEOは実質的にほぼ同じ範囲をカバーしますが、LLMOは実務家コミュニティから自然発生的に広まった用語であるのに対し、GEOはジョージア工科大学の研究チームが論文で提唱した学術的な用語、という違いがあります。

実務的な結論を述べると、これらの用語を厳密に使い分ける必要はありません。重要なのは用語ではなく、「AI検索全般に自社コンテンツを最適化する」という共通のゴールです。日本国内では「LLMO」が最も広く使われているため、本記事でもこの用語を統一して使用しています。

もう一つ強調しておきたいのが、LLMOとSEOは二者択一ではなく補完関係にあるという点です。「SEOはもう不要で、これからはLLMOだ」という極端な意見を見かけることがありますが、これは事実に反します。Google検索で上位表示されているコンテンツは、AI Overviewにも引用されやすい傾向が明確にあります。その理由はシンプルで、GoogleのAI OverviewはGoogleの検索インデックスを情報源として使っているからです。SEOの基盤を固めたうえで、LLMO特有の対策を積み上げる——これが最も合理的なアプローチです。詳しくは「AIOとSEOの違いと統合戦略」で掘り下げています。

LLMOの具体的な対策手法7選 — 今日から始める実践ガイド

ここからは、LLMOの具体的な対策手法を優先度の高い順に7つ紹介します。前半で解説した「チャンク単位で引用される」「RAGの仕組み」を念頭に置きながら読むと、なぜその対策が有効なのかがより深く理解できるはずです。

対策1. 質問応答型コンテンツの設計(最優先・効果大)

LLMOにおいて最も重要かつ即効性のある対策が、コンテンツを「質問と回答のペア」で構成することです。これが最優先である理由は、RAGの仕組みに直結しているからです。

前述の通り、AIはユーザーの「質問」に対して、Web上から「回答として使えるチャンク」を探します。つまり、コンテンツ側に「明確な質問」と「それに対する簡潔な回答」のペアが存在していれば、AIにとって「引用しやすい情報源」になるのです。

具体的に何をすればよいかというと、まずH2やH3の見出しをユーザーの検索意図に合った質問形式にします。「LLMOの概要」よりも「LLMOとは?」、「SEOとの相違点」よりも「LLMOとSEOの違いは?」の方が、AIがクエリとのマッチングを取りやすくなります。

次に、各セクションの冒頭2〜3文で結論を述べる「結論ファースト」の構成にします。たとえば「LLMOとは?」という見出しの直後に「LLMOとは、ChatGPTやGeminiなどのAI検索に自社コンテンツを引用させるための最適化手法です」という定義文を配置する。こうすることで、AIはこの1文だけを抜き出しても意味が通じる「引用しやすいチャンク」として扱えます。

さらに、文中に具体的な数値を含めることも効果的です。「約40%のクエリでAI Overviewが表示される」「5つのステップで実装できる」のように、数値を含む文はAIが回答に取り込みやすいことが、ジョージア工科大学のGEO研究で示されています。

対策2. E-E-A-Tの徹底強化

E-E-A-T(Experience・Expertise・Authoritativeness・Trustworthiness)は、Googleの品質評価ガイドラインで定義された評価軸で、SEOでは以前から重要視されてきました。そしてこのE-E-A-Tは、LLMOにおいてはさらに決定的な役割を果たします。

なぜかというと、AIが複数の情報ソースから1つを選んで引用する際の判断基準が、まさに「どの情報源が最も信頼できるか」だからです。同じ内容を書いている記事が10個あったとき、AIは著者の専門性が明確で、一次データに基づいており、他のサイトからも参照されている記事を優先的に引用します。

では、具体的にどうE-E-A-Tを強化するのか。最も効果が大きいのは一次情報の公開です。「実際にllms.txtを導入したところ、3ヶ月でAI検索からのリファラルトラフィックが167%増加した」のような実体験ベースのデータは、他サイトにはコピーできない独自の価値を持ちます。scale-basics.comでは、このアプローチを徹底した結果、Perplexityでの引用回数が対策前と比較して約2.5倍に増加しました。

また、著者プロフィールの充実も重要です。記事ごとに著者名・肩書き・経歴を明記し、著者紹介ページを作成してOrganizationやPerson構造化データでマークアップする。さらに、統計データを引用する際は必ず出典(調査機関名、年度、URL)を明記する。これらの「信頼性の証拠」を積み重ねることで、AIから「信頼できる情報源」として認識されやすくなります。

対策3. 構造化データ(Schema.org)の最適化

構造化データは、Webページの内容を検索エンジンやAIが機械的に理解できる形式で記述するための仕組みです。人間が読む「見た目のHTML」とは別に、「このページはFAQ形式で、こういう質問にこう回答しています」という情報をJSON-LD形式で埋め込みます。

構造化データがLLMOに効く理由は明快です。AIが情報を取得する際、HTMLの構造だけでは「この段落がQ&Aの回答なのか、単なる説明文なのか」を正確に判別できないことがあります。しかし、FAQPageスキーマで「これは質問、これは回答」と明示されていれば、AIは迷わずその情報を引用候補として扱えるのです。

LLMO対策で特に効果が高い構造化データのタイプは以下の通りです。

| スキーマタイプ | 用途 | LLMO効果 |

|---|---|---|

| FAQPage | Q&A形式のコンテンツ | ★★★★★(最高) |

| HowTo | 手順説明コンテンツ | ★★★★☆ |

| Article | 著者・日付の明示 | ★★★★☆ |

| Organization | 企業・組織情報 | ★★★☆☆ |

中でもFAQPageスキーマはLLMOとの相性が抜群です。以下に、コピペでそのまま使える実装例を示します。

<!-- FAQPage構造化データ(JSON-LD) -->

<script type="application/ld+json">

{

"@context": "https://schema.org",

"@type": "FAQPage",

"mainEntity": [

{

"@type": "Question",

"name": "LLMOとは何ですか?",

"acceptedAnswer": {

"@type": "Answer",

"text": "LLMO(Large Language Model Optimization)とは、ChatGPTやGeminiなどのAI検索エンジンに自社コンテンツを引用・推奨させるための最適化手法です。"

}

},

{

"@type": "Question",

"name": "LLMOとSEOの違いは?",

"acceptedAnswer": {

"@type": "Answer",

"text": "SEOはGoogleの検索アルゴリズムを対象にページ単位で最適化しますが、LLMOはLLMを対象に段落・チャンク単位で最適化します。情報の正確性と構造化がより重視されます。"

}

}

]

}

</script>構造化データの詳しい実装方法やバリデーションの手順は「構造化データマークアップ完全ガイド」でJSON-LDのコード例付きで解説しています。

対策4. llms.txtの設置と活用

llms.txtは、2024年に提唱された比較的新しい仕組みで、「robots.txtのLLM版」とも呼ばれています。robots.txtがクローラーに「アクセスしてよい場所・してはいけない場所」を指示するのに対し、llms.txtはAIクローラーに「このサイトの重要な情報はここにあります」と積極的に情報提供する役割を果たします。

設置は非常に簡単で、サイトのルートディレクトリにllms.txtというテキストファイルを配置するだけです。llms.txtの公式仕様に基づいた具体的な記述例を示します。

# llms.txt

# サイト名: scale-basics.com

# 概要: SEO×AIO実践カリキュラムの教材サイト&コラムブログ

## サイトの目的

SEOとAI検索最適化(LLMO/AIO/GEO)を体系的に学べる

実践的な教材とコラム記事を提供するWebサイトです。

## 主要コンテンツ

- SEO基礎から応用までの全29章のカリキュラム

- AIO・LLMO・GEOの実践ガイド記事

- テクニカルSEO、コンテンツSEO、データ分析のコラム

## 専門分野

SEO, AIO, LLMO, GEO, テクニカルSEO, コンテンツSEO,

構造化データマークアップ, Web制作, AI検索最適化

## 連絡先

https://scale-basics.com/contact正直なところ、2026年3月時点ではllms.txtを読み取るAIクローラーはまだ限定的です。しかし、設置にかかる時間は10分程度と極めて少なく、デメリットは実質ゼロです。今後の標準化を見据えて早期に設置しておけば、対応が広がったときに先行者利益を得られます。llms.txtの仕様や高度な設定については、第22章 GEO・RAGO・llms.txt — AI検索最適化の実装で体系的に解説しています。

対策5. エンティティの確立と情報の一貫性

エンティティとは、人・組織・概念・製品などの「固有の存在」のことです。LLMは世界をこのエンティティの集合として理解しており、回答を生成する際にも「このエンティティは信頼できるか」「このエンティティについてWeb上にどんな情報があるか」を総合的に判断しています。

たとえば、「SEOツールのおすすめは?」とAIに質問したとき、AIは「Ahrefs」「SEMrush」「Moz」といったエンティティを認識し、それぞれの評判・機能・価格をWeb上の複数の情報源から統合して回答を生成します。このとき、Web上で一貫して高く評価されているエンティティは、AIの回答でも優先的に推奨されます。

自社や自社サービスをエンティティとしてAIに正しく認識させるためには、まずGoogleビジネスプロフィールの情報を正確に登録・更新します。次に、Organization構造化データで企業情報をマークアップし、SNSや外部メディアでも統一された情報を発信します。できれば、Wikipedia や業界メディアでの言及を獲得し、NAP情報(Name・Address・Phone)がWeb上のどこでも一貫していることを確認しましょう。

ポイントは「一貫性」です。自社サイト、Googleビジネスプロフィール、SNS、外部メディアのそれぞれで異なる情報が掲載されていると、AIは「この情報源は信頼できない」と判断する可能性があります。すべてのチャネルで統一された情報を発信することが、エンティティとしての信頼性を高める鍵です。

対策6. サイテーション(外部言及)の獲得

サイテーションとは、外部のWebサイトやメディアで自社やコンテンツが言及されることです。被リンク(バックリンク)と似た概念ですが、重要な違いがあります。被リンクは「リンクが付いている」ことが条件ですが、サイテーションはリンクがなくてもテキストでの言及自体がLLMOに効果があるのです。

なぜサイテーションが効くのかというと、LLMの事前学習プロセスに関係しています。LLMはWeb上の膨大なテキストを学習する中で、「多くの文脈で肯定的に言及されているエンティティ」を「信頼性が高い」と内部的に評価します。つまり、業界メディアやブログで自社が繰り返し言及されていれば、LLMの「世界認識」の中で自社の位置づけが向上するのです。

効果的なサイテーション獲得の方法としては、まず独自調査やレポートの公開が最も効果的です。「〇〇業界における△△の実態調査」のような引用されやすいオリジナルデータは、他のメディアが自然に参照・言及してくれます。また、業界メディアへの寄稿やプレスリリースの配信、SNSでの専門性の高い情報発信も有効です。

対策7. AI検索エンジン別の個別対策

前述の通り、各AI検索エンジンは情報の取得元が異なります。ChatGPTはBing、GeminiはGoogle、Perplexityは独自クロールをベースにしています。この違いを理解したうえで、主要なサービスごとに追加の対策を行うと効果的です。

| AI検索 | 情報ソース | 重視ポイント | 具体的な対策 |

|---|---|---|---|

| ChatGPT | Bing検索 | Bing SEO、コンテンツの鮮度 | Bing Webマスターツールへの登録、IndexNow対応でコンテンツ更新を即時通知 |

| Gemini / AI Overview | Googleインデックス | Google SEO、構造化データ | FAQPageスキーマの実装、E-E-A-T強化、Google Search Consoleでのモニタリング |

| Perplexity | 独自クロール | 一次情報、数値データの充実 | 独自調査データの公開、robots.txtでPerplexityBotをブロックしていないか確認 |

全てに個別対応するのは工数がかかるため、まずはGoogleのAI Overview対策(=従来のSEO強化+構造化データ)から始め、余裕があればBing対策とPerplexity対策を追加するのが現実的です。各AIサービス別の詳しいチェックリストは「LLMO対策の完全チェックリスト」で網羅的にまとめています。

【実践事例】scale-basics.comでのLLMO対策と成果

理論だけでは実感が湧きにくいと思いますので、当サイト(scale-basics.com)で実際に実施したLLMO対策とその成果を共有します。

scale-basics.comは、SEOとAI検索最適化の教材を提供するサイトで、2025年後半からLLMO対策に本格的に取り組みました。実施した施策は以下の5つです。

- 全記事にFAQPageおよびArticle構造化データを実装:各記事の主要なQ&Aを抽出し、JSON-LDでマークアップ

- 結論ファーストの段落構成に全記事をリライト:各セクション冒頭に定義文や結論文を配置

- llms.txtの設置:サイトの概要と主要コンテンツをAIクローラーに伝達

- 著者プロフィールの充実:資格・経歴・実績を明記した著者ページを作成

- 独自検証データの掲載:LLMO対策の実施前後のデータを記事内に掲載

これらの施策を3ヶ月間(2025年12月〜2026年2月)実施した結果が以下の通りです。

| 指標 | 対策前 | 対策後(3ヶ月) | 変化率 |

|---|---|---|---|

| Perplexityでの引用回数(月間) | 3回 | 8回 | +167% |

| AI Overview引用ページ数 | 2ページ | 5ページ | +150% |

| AI検索リファラルトラフィック | 月間42セッション | 月間156セッション | +271% |

| 構造化データエラー | 5件 | 0件 | 解消 |

この結果から言えるのは、LLMO対策は「理論上有効」なだけでなく、実際に測定可能な成果を生むということです。特に効果が大きかったのは施策①②、つまり「構造化データの実装」と「結論ファーストへのリライト」でした。この2つだけでもPerplexityでの引用率が目に見えて向上しており、最初に取り組む施策として強くおすすめします。

LLMOで期待できるメリットとリスク

LLMO対策に投資する価値があるかどうかを判断するために、メリットとリスクの両面を正直に整理します。

| メリット | リスク・注意点 |

|---|---|

| AI検索経由の新規トラフィック獲得 | 効果測定の標準的な方法がまだ確立途上 |

| ブランド認知の向上(AIに推奨される信頼感) | AIがハルシネーション(誤情報)で自社を不正確に紹介するリスク |

| 先行者利益の確保(対策している競合がまだ少ない) | 各AIサービスごとに対策内容が異なり、運用工数が増える |

| 従来SEO対策との高い互換性(二重投資にならない) | 中長期的な継続運用が必要で、短期的なROIが見えにくい |

| 指名検索の増加(AIでの推奨→ブランド検索の増加) | AIの仕様変更により効果が変動する可能性 |

この表で最も注目すべきは「従来SEO対策との高い互換性」です。LLMO対策として行うE-E-A-Tの強化、構造化データの実装、コンテンツの構造改善は、そのままGoogleの検索順位にもプラスに作用します。つまり、「LLMOのためだけに追加コストが発生する」のではなく、「SEOとLLMOの両方に効く施策に投資する」という考え方ができるのです。これがLLMO対策の投資判断を容易にするポイントです。

LLMOの効果測定方法 — KPIの設定と実践

「対策はしたけど、効果が出ているのかわからない」——これはLLMO対策に取り組む多くの企業が直面する課題です。従来のSEOのように「検索順位」という明確な指標がないため、効果測定には工夫が必要です。以下に、現時点で実践的に使えるKPIと測定方法をまとめます。

| KPI | 具体的な測定方法 | 推奨頻度 |

|---|---|---|

| AI検索での引用率 | 自社関連の主要クエリ20〜30個をリスト化し、ChatGPT・Gemini・Perplexityで定期的に検索して引用有無を記録する | 月次 |

| AIリファラルトラフィック | GA4の参照元レポートで「perplexity.ai」「chatgpt.com」等からの流入セッション数を計測する | 週次 |

| ブランドメンション率 | 「○○のおすすめは?」「○○ならどこ?」のような推奨クエリをAIに投げ、自社が言及されるかを確認する | 月次 |

| 構造化データカバレッジ | Google Search Consoleの拡張レポートでエラー0件を維持しているか確認する | 月次 |

また、GA4でAI検索からの流入を正確に計測するためには、以下のようにカスタムセグメントを設定すると便利です。

// GA4でAI検索流入を計測するカスタムセグメント設定例

// 「探索」レポートでセグメントを新規作成

// セグメント条件:

// セッションの参照元に以下のいずれかを含む

// - perplexity.ai

// - chatgpt.com

// - gemini.google.com

// - copilot.microsoft.com

//

// これにより、AI検索経由のトラフィック全体を

// 1つのセグメントで横断的に分析できます効果測定の体系的なフレームワークについては、第23章 AI可視性の計測と従来SEO×AIOの統合戦略でさらに詳しく解説しています。

LLMO対策に使えるツール一覧

最後に、LLMO対策を効率的に進めるためのツールを紹介します。高額な専用ツールもありますが、まずは無料ツールで十分に始められます。

| ツール | 用途 | 料金 |

|---|---|---|

| Perplexity | 自社コンテンツがAI検索でどう引用されるか確認。出典URLが必ず表示されるため、引用状況の確認に最適 | 無料〜$20/月 |

| ChatGPT | 自社ブランドのAI上での認知度チェック。推奨クエリで自社が言及されるか確認 | 無料〜$20/月 |

| Otterly.AI | AI検索でのブランド可視性を自動モニタリング。定点観測に便利 | 有料 |

| Schema Markup Validator | 構造化データの文法エラーをチェック。実装後の検証に必須 | 無料 |

| リッチリザルトテスト | Googleが構造化データを正しく認識しているか確認 | 無料 |

| Ahrefs / SEMrush | 被リンク・サイテーションの分析、競合のLLMO状況調査 | 有料 |

おすすめの始め方は、まずPerplexityとChatGPTで自社関連のキーワードを10個ほど検索し、現状の引用状況を把握することです。「そもそも自社が言及されているのか」「言及されているとしたら正確か」を知るだけでも、今後の対策の方向性が明確になります。

LLMOに関するよくある質問

Q. LLMOとSEOはどちらを優先すべき?

SEOが先です。理由はシンプルで、Google検索で上位表示されているコンテンツは、AI Overviewにも引用されやすい傾向が確認されているからです。GoogleのAI OverviewはGoogleの検索インデックスを情報源としており、SEOで評価されているコンテンツ=AIにも信頼される情報源、という関係が成り立っています。まずSEOの基盤(テクニカルSEO、コンテンツSEO、被リンク)を固め、その上にLLMO特有の対策を積み上げるのが最も効率的なアプローチです。

Q. LLMO対策の効果はどれくらいで出る?

施策によって異なります。結論ファーストの構成変更やFAQPageスキーマの実装といった「コンテンツ・構造の改善」は、AIがそのページをリクロールすれば比較的早く(数週間程度で)効果が現れることがあります。一方、E-E-A-Tの強化やサイテーションの獲得といった「信頼性の構築」は、本質的に中長期(3〜6ヶ月以上)の取り組みが必要です。scale-basics.comの場合、構造化データ実装から約6週間で最初のPerplexity引用増加を確認しました。

Q. 小規模サイトでもLLMO対策は有効?

むしろ小規模サイトにこそチャンスがあります。前述の通り、LLMOでは「ページ全体のドメインパワー」よりも「チャンク単位の情報の質」が重視されます。特定の専門分野で他にはない一次情報を発信していれば、大規模サイトと競合しなくても、AIに「その分野の専門的な情報源」として引用される可能性は十分にあります。ニッチな専門性で勝負する戦略は、小規模サイトにとってLLMO時代の大きなアドバンテージです。

まとめ — LLMOはSEOの進化形、今すぐ始めるべき3つの理由

LLMOは、SEOに取って代わるものではなく、SEOの自然な進化形です。ユーザーの情報探索行動がAIを介したものに拡張される中で、自社のコンテンツを適切に届けるための新しい最適化レイヤーがLLMOなのです。

今すぐLLMOに取り組むべき理由は3つあります。第一に先行者利益です。LLMO対策に本格的に取り組んでいる企業はまだ少数派であり、今始めれば競合に先んじたポジションを確立できます。第二にSEOとの高い互換性です。LLMO対策として行う施策の多くはSEO効果も持つため、二重の投資にはなりません。そして第三に変化の不可逆性です。AI検索の普及は加速こそすれ、後戻りすることはありません。対策が遅れるほど、追いつくコストは大きくなります。

今日から始められる3つのアクション:

- ChatGPT・Perplexityで自社関連のクエリを10個検索し、現状の引用状況を把握する

- 主要ページの見出しを質問応答型に変更し、各セクション冒頭に結論ファーストの定義文を配置する

- FAQPage構造化データを1ページでも実装して、効果を検証する

LLMO対策の具体的なチェックリストは「LLMO対策の完全チェックリスト」で確認できます。また、AI検索最適化の全体像を体系的に学びたい方は、第21章 AI検索の仕組みとAIO基礎から順に進めるカリキュラムがおすすめです。